本文翻译自 Andrej Karpathy 发布在 X 上的对于 2025 年 LLM 的年度回顾:2025 LLM Year in Review.

2025 年是 LLM(大型语言模型)取得长足进步且充满大事的一年。以下是一份我个人认为值得注意且略显意外的“范式转变”清单——这些事物改变了格局,并在概念上令我印象深刻。

1. 基于可验证奖励的强化学习 (RLVR)

在 2025 年初,各大实验室的 LLM 生产技术栈看起来大概是这样的:

- 预训练 (Pretraining, 约 2020 年的 GPT-2/3)

- 监督微调 (Supervised Finetuning, 约 2022 年的 InstructGPT)

- 基于人类反馈的强化学习 (RLHF, 约 2022 年)

在很长一段时间里,这是训练生产级 LLM 的稳定且行之有效的配方。在 2025 年,基于可验证奖励的强化学习 (RLVR) 崛起,成为了这一组合中事实上的新增主要阶段。通过在多个环境(例如数学/代码谜题)中针对可自动验证的奖励来训练 LLM,LLM 自发地发展出了在人类看来像是“推理”的策略——它们学会了将解决问题的过程分解为中间计算步骤,并学会了多种反复推敲以弄清问题的解题策略(参见 DeepSeek R1 论文中的例子)。这些策略在以前的范式中很难实现,因为对于 LLM 来说,最佳的推理轨迹和纠错方式是什么并不明确——它必须通过针对奖励的优化,自己找到行之有效的方法。

与 SFT 和 RLHF 阶段(这两个阶段相对较薄/较短,计算上只是微小的微调)不同,RLVR 涉及针对客观(不可被操纵)奖励函数的训练,这允许进行更长时间的优化。事实证明,运行 RLVR 提供了极高的能力/成本比,它吞噬了原本用于预训练的计算资源。因此,2025 年的大部分能力进步都是由 LLM 实验室消化这一新阶段的“剩余红利”所定义的,总体而言,我们看到了体量相似的 LLM,但 RL 运行时间要长得多。此外,这一新阶段独有的是,我们获得了一个全新的旋钮(以及相关的缩放定律),可以通过生成更长的推理轨迹和增加“思考时间”来控制作为测试时计算量函数的能力。OpenAI o1(2024 年末)是 RLVR 模型的首次演示,但 o3 的发布(2025 年初)是一个明显的拐点,你能直观地感受到这种差异。

2. 幽灵 vs 动物 / 锯齿状智能

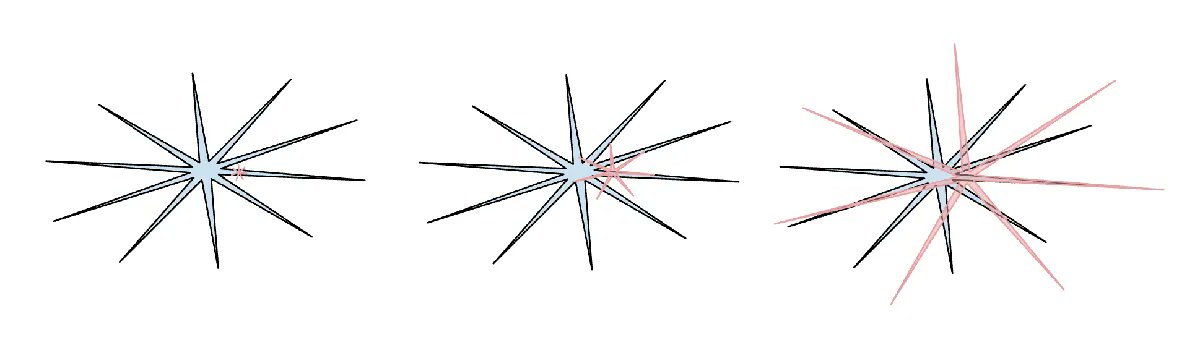

2025 年是我(我想整个行业也是如此)第一次开始更直观地内化 LLM 智能的“形状”的一年。我们不是在“进化/培育动物”,我们是在“召唤幽灵”。LLM 技术栈的一切都不同(神经架构、训练数据、训练算法,尤其是优化压力),所以我们在智能空间中得到非常不同的实体也就不足为奇了,用动物的视角来思考它们是不恰当的。就监督层面而言,人类神经网络是为了丛林部落的生存而优化的,但 LLM 神经网络是为了模仿人类文本、在数学谜题中收集奖励以及在 LM Arena 上获得人类点赞而优化的。由于可验证领域允许 RLVR,LLM 在这些领域附近的能力会“突刺”,总体上表现出有趣的锯齿状性能特征——它们同时是天才博学家,又是一个困惑且认知受损的小学生,只需几秒钟就会被越狱手段诱骗窃取你的数据。

[图片说明] 人类智能:蓝色,AI 智能:红色。我喜欢这个版本的梗图(很抱歉我弄丢了它在 X 上原始帖子的引用),它指出了人类智能也以其独特的方式呈现锯齿状。

与此相关的是我在 2025 年对基准测试(Benchmarks)普遍产生的冷漠和信任丧失。核心问题在于,基准测试几乎在构建上就是可验证的环境,因此很容易受到 RLVR 及其较弱形式(通过合成数据生成)的影响。在典型的“刷榜”(benchmaxxing)过程中,LLM 实验室的团队不可避免地构建了与基准测试所占据的嵌入空间小口袋相邻的环境,并生长出“锯齿”来覆盖它们。在测试集上训练成了一种新的艺术形式。

横扫所有基准测试却仍未实现 AGI(通用人工智能),这究竟是一番什么景象?

关于本节的话题,我在这里写了更多内容:

3. Cursor / LLM 应用的新层级

关于 Cursor,我发现最值得注意的(除了它今年飞速崛起之外)是它令人信服地揭示了“LLM 应用”的一个新层级——人们开始谈论“X 领域的 Cursor”。正如我在今年的 Y Combinator 演讲中所强调的那样(transcript and video),像 Cursor 这样的 LLM 应用为特定垂直领域捆绑并编排 LLM 调用:

- 它们进行“上下文工程”

- 它们在后台编排多个 LLM 调用,串联成日益复杂的 DAG(有向无环图),仔细平衡性能和成本的权衡。

- 它们为处于循环中的人类提供特定于应用程序的 GUI(图形用户界面)。

- 它们提供一个“自主性滑块”。

2025 年有很多关于这个新应用层有多“厚”的讨论。LLM 实验室会吞并所有应用,还是 LLM 应用仍有广阔天地?我个人怀疑,LLM 实验室将倾向于培养出能力通用的“大学生”,但 LLM 应用将通过提供私有数据、传感器、执行器和反馈循环,将这些大学生组织、微调并真正地“动画化”为特定垂直领域的已部署专业人员。

4. Claude Code / 活在你电脑上的 AI

Claude Code (CC) 成为第一个令人信服的 LLM Agent(智能体)演示——它以一种循环的方式将工具使用和推理串联起来,以解决长期问题。此外,CC 对我来说值得注意的是,它运行在你的计算机上,使用你的私有环境、数据和上下文。我认为 OpenAI 搞错了这一点,因为我认为他们将 codex / agent 的工作重点放在了从 ChatGPT 编排的云端容器部署上,而不是 localhost。虽然在云端运行的智能体集群感觉像是“AGI 的终局”,但我们生活在一个能力参差不齐的中间过渡期和缓慢起飞的世界中,因此将智能体直接运行在计算机上,与开发人员及其特定设置携手合作更有意义。CC 掌握了正确的优先级顺序,并将其打包成一种美观、极简、引人注目的 CLI(命令行界面)形式,这改变了 AI 的样子——它不仅仅是一个像 Google 那样你去访问的网站,它是一个“活”在你电脑里的小精灵/幽灵。这是一种全新的、独特的与 AI 交互的范式。

5. Vibe coding

2025 年是 AI 跨越能力阈值的一年,只需通过英语即可构建各种令人印象深刻的程序,甚至完全忘掉代码的存在。有趣的是,我在 this shower of thoughts tweet 中创造了“氛围编程 (vibe coding)”这个词,当时完全没想到它会发展到这一步 :)。有了氛围编程,编程不再是受过高度训练的专业人士的专利,而是任何人都可以做的事情。在这个意义上,这又是我在 Power to the people: How LLMs flip the script on technology diffusion 中写过的例证,即(与迄今为止所有其他技术形成鲜明对比的是)普通人从 LLM 中受益的程度远高于专业人士、公司和政府。但这不仅让普通人能够接触编程,还让受过训练的专业人士能够编写更多原本永远不会被编写出来的(氛围编码的)软件。在 nanochat 中,我用 Rust “氛围编程”了我自己定制的高效 BPE 分词器,而不必采用现有的库或学习该级别的 Rust。今年我“氛围编程”了许多项目,作为我希望存在的某种东西的快速应用演示(例如参见 menugen, llm-council, reader3, HN time capsule)。我还“氛围编程”了整个临时的应用程序,仅仅是为了找到一个 Bug,因为为什么不呢——代码突然变得免费、短暂、可塑、一次性使用后即可丢弃。“氛围编程”将改造软件行业并改变职位描述。

6. Nano banana / LLM GUI

Google Gemini Nano banana 是 2025 年最令人难以置信、最具范式转移意义的模型之一。在我的世界观中,LLM 是下一个主要的计算范式,类似于 70 年代、80 年代的计算机等。因此,我们将出于根本上相似的原因看到类似的创新。我们将看到个人计算、微控制器(认知核心)或互联网(智能体网络)等的等价物。特别是在 UIUX(用户界面/用户体验)方面,与 LLM “聊天”有点像是在 80 年代向计算机控制台发出指令。文本是计算机(和 LLM)原始/偏爱的数据表示形式,但并不是人类偏爱的格式,尤其是在输入端。人们其实不喜欢阅读文本——它既慢又费力。相反,人们喜欢在视觉和空间上消费信息,这就是为什么在传统计算中发明了 GUI。同样,LLM 应该用我们要喜欢的格式与我们交谈——通过图像、信息图表、幻灯片、白板、动画/视频、Web 应用程序等。这种方式的早期和当前版本当然是像表情符号和 Markdown 之类的东西,它们是用标题、粗体、斜体、列表、表格等方式“装饰”和布局文本以便于消费的方法。但是,谁来构建 LLM GUI 呢?在这个世界观中,nano banana 是这种未来可能样貌的第一个早期暗示。重要的是,它值得注意的一个方面是,这不仅仅关于图像生成本身,而是关于来自文本生成、图像生成和世界知识的联合能力,所有这些都纠缠在模型权重中。

总结 (TLDR)

2025 年是 LLM 令人兴奋且略显意外的一年。LLM 正在作为一种新型智能涌现,同时比我预期的要聪明得多,也比我预期的要笨得多。无论如何,它们极其有用,而且我认为即使以目前的能力,整个行业也没有实现其潜力的 10%。与此同时,有太多的想法可以尝试,从概念上讲,这个领域感觉完全开放。正如我今年早些时候在 Dwarkesh pod 中提到的那样,我同时(表面上看起来矛盾地)相信,我们将看到快速且持续的进步,并且仍有大量工作要做。系好安全带。

URL:我将这篇文章交叉发布到了我的 博客 上,我认为那里看起来和感觉起来更好一点,不那么笨重。