大型语言模型(LLMs)的飞速发展,极大地拓展了人工智能的应用领域,它们在文本生成、语言理解、代码编写等多个方面展现出强大的能力。然而,这些模型的一个固有局限在于,它们的能力很大程度上受限于其训练数据的范围。这意味着,LLMs 往往缺乏对实时信息的感知(联网搜索),也无法直接与外部世界进行交互以执行具体的操作。

为了弥补这一不足,传统的做法是为每一个需要连接的数据源(如数据库、API、文件系统)和工具构建定制化的集成方案。然而,随着 AI 模型和外部工具数量的不断增长,这种方法很快变得难以维护和扩展,导致了一个被称为“MxN 问题”的局面——即 M 个 AI 模型需要与 N 个外部工具进行连接,所需的集成数量是 M 乘以 N。

这种“MxN 问题”暴露了当前 AI 生态系统在数据连接方面的瓶颈。每当出现一个新的 LLM 或一个新的外部工具,就需要进行大量的重复开发工作来建立它们之间的通信桥梁。这种复杂性不仅拖慢了 AI 应用的开发速度,也增加了维护成本,并限制了不同 AI 模型和工具之间的互操作性。

为了应对这些挑战,Anthropic 在 2024 年 11 月推出了模型上下文协议(Model Context Protocol,简称 MCP)。MCP 旨在成为一个开放的标准,用于规范 AI 助手如何连接到存储数据的各种系统,包括内容仓库、业务工具和开发环境。

MCP 协议刚推出时并没有引起什么反响,直到今年 3 月份,MCP 协议开始火起来,并被越来越多的公司所支持,如Cursor、Github、Google、Cloudflare 等等,就连 OpenAI 在前几天也宣布要支持 MCP 协议(另外,Anthropic 也偷偷兼容了 OpenAI SDK,可能他们做了对等的交易?)。国内这边,很多公司也在跟进和支持 MCP 协议,如百度地图、高德地图等等。

什么是模型上下文协议 (MCP)?

模型上下文协议(MCP)是一个开放协议,它定义了一种标准化的方式,使得应用程序能够为大型语言模型(LLMs)提供上下文信息。其核心目标是实现 AI 模型与外部工具、数据库和 API 之间的无缝且标准化的集成。

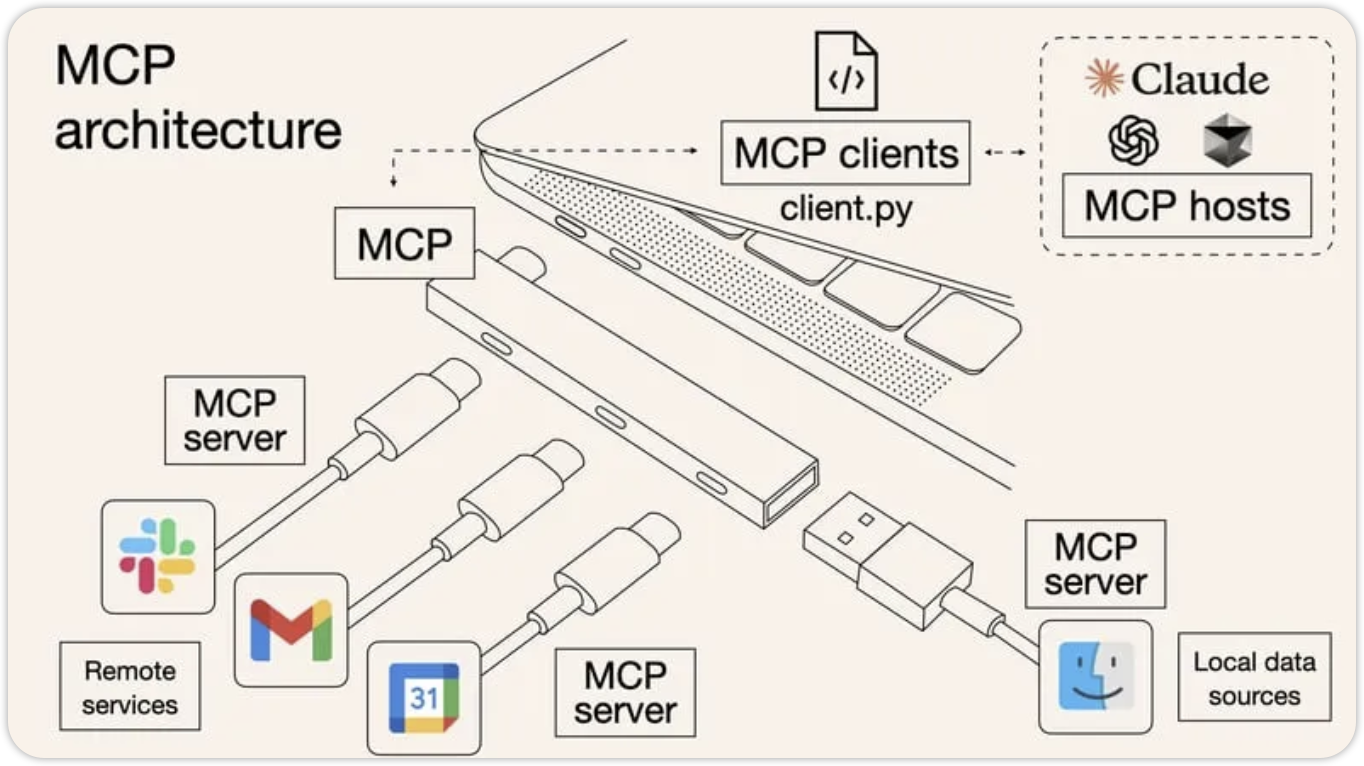

可以将 MCP 视为 AI 领域的“USB-C 接口”。正如 USB-C 为各种设备连接到计算机提供了通用的接口一样,MCP 为 AI 模型与各种外部资源进行交互提供了一个标准化的方法。它充当了一个“通用连接器”或“通用适配器”,使得 LLMs 能够动态地与外部资源进行交互,从而获取实时的、准确的、相关的信息,并利用外部工具执行任务。

MCP 的主要设计目标包括:

- 标准化 AI 集成:提供一种结构化和一致的方式来连接 AI 模型与外部工具和数据源,从而促进互操作性并减少对定制化集成的需求。

- 灵活性:允许在不同的 AI 模型和供应商之间轻松切换,而无需对集成进行大规模修改。

- 增强上下文感知:通过使 AI 模型能够访问来自各种来源的最新信息,克服其训练数据截止日期的限制。

- 可操作性:使 AI 模型不仅能够接收信息,还能够触发外部系统中的操作,从而实现更动态和交互式的应用程序。

- 解决“MxN 问题”:用一种更简单、更可扩展的架构取代复杂的定制化集成,在这种架构中,M 个模型和 N 个工具都遵循 MCP 标准。

MCP 的架构

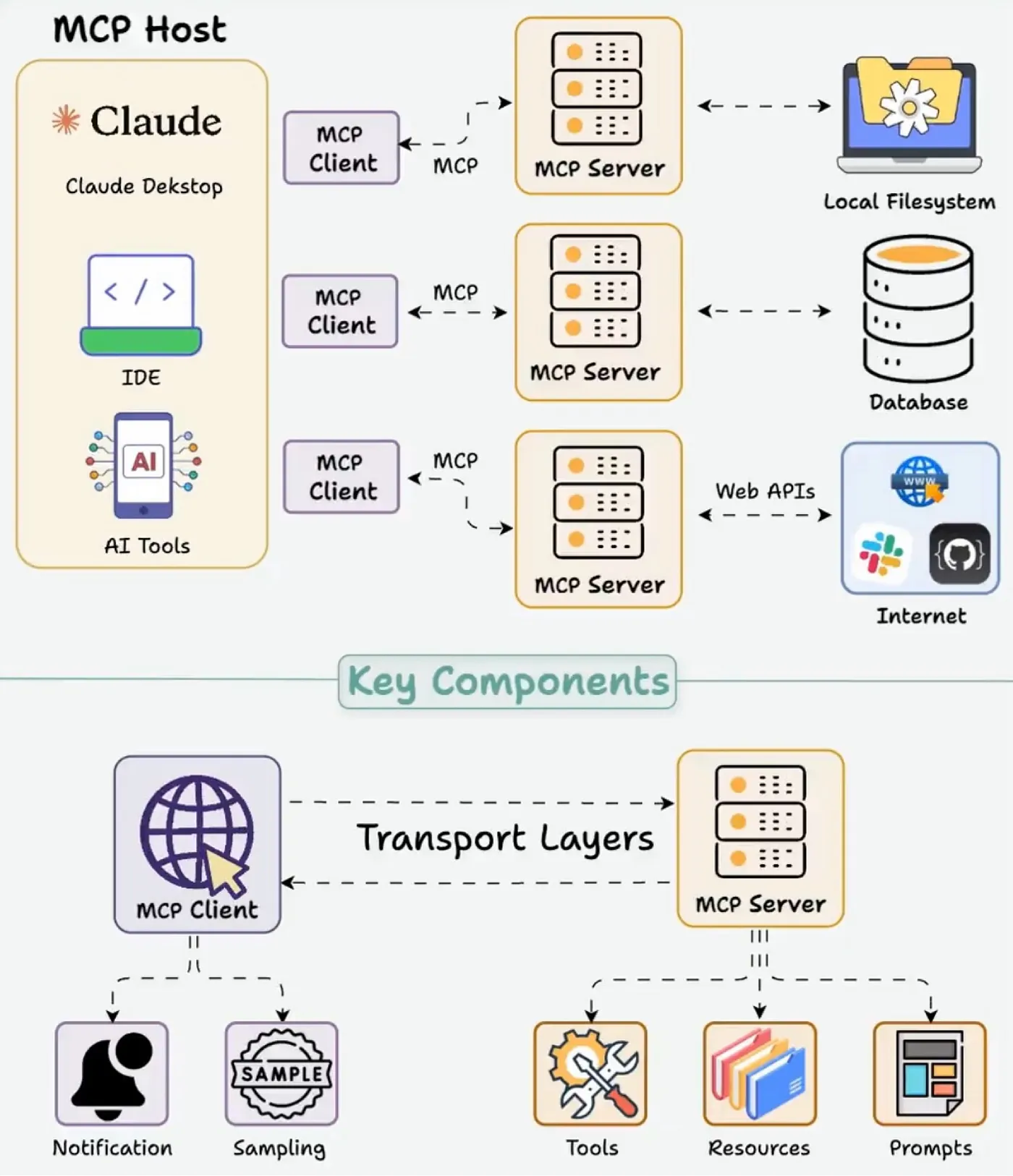

模型上下文协议(MCP)基于客户端-服务器架构运行,包含三个关键组成部分:

- 主机端 (Host):一个 AI 应用程序(例如 Claude 桌面版、Cursor),它为 AI 交互提供环境,能够访问工具和数据,并运行 MCP 客户端。

- MCP 客户端 (MCP Client):在主机端内部运行,负责实现与 MCP 服务器的通信。

- 服务器 (Server):处理来自 MCP 客户端的请求,进行数据处理,并返回相关的响应。

MCP 客户端负责发起与 MCP 服务器的连接,并发送请求以检索信息或执行特定任务。它们管理与服务器的通信,发现服务器提供的功能(如可用的工具、资源和提示),并有效地利用这些功能。此外,客户端还处理连接管理、错误处理,并且通常实施安全措施,例如在 AI 执行某些操作之前需要人工批准。

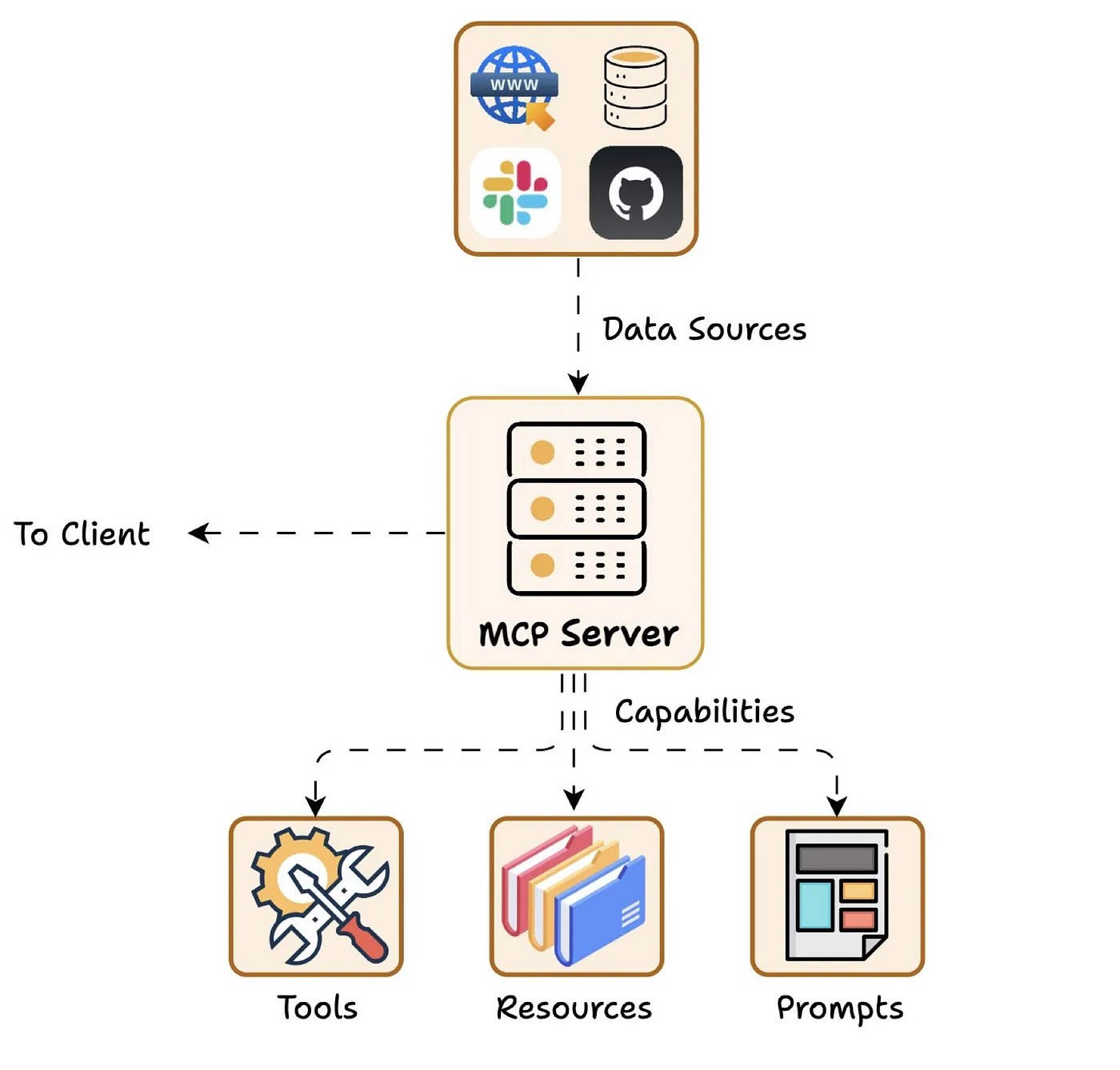

MCP 服务器是轻量级的程序或服务,它们提供对外部工具和数据源的访问。它们充当通往数据库、API、文件系统和其他系统的网关。MCP 服务器通过“原语”(primitives)定义并向 AI 客户端暴露特定的功能。这些原语包括:

- 工具(Tools):可执行的函数或操作,AI 模型可以通过服务器调用它们来执行诸如查询数据库或发送电子邮件之类的任务。

- 资源(Resources):结构化数据,例如文档片段或代码片段,服务器可以提供这些数据以丰富模型的上下文。

- 提示(Prompts):预先编写的指令或模板,用于指导 AI 模型与服务器的交互或执行特定任务。

服务器处理来自客户端的请求,与底层的数据库或工具进行交互,并将响应发送回客户端。

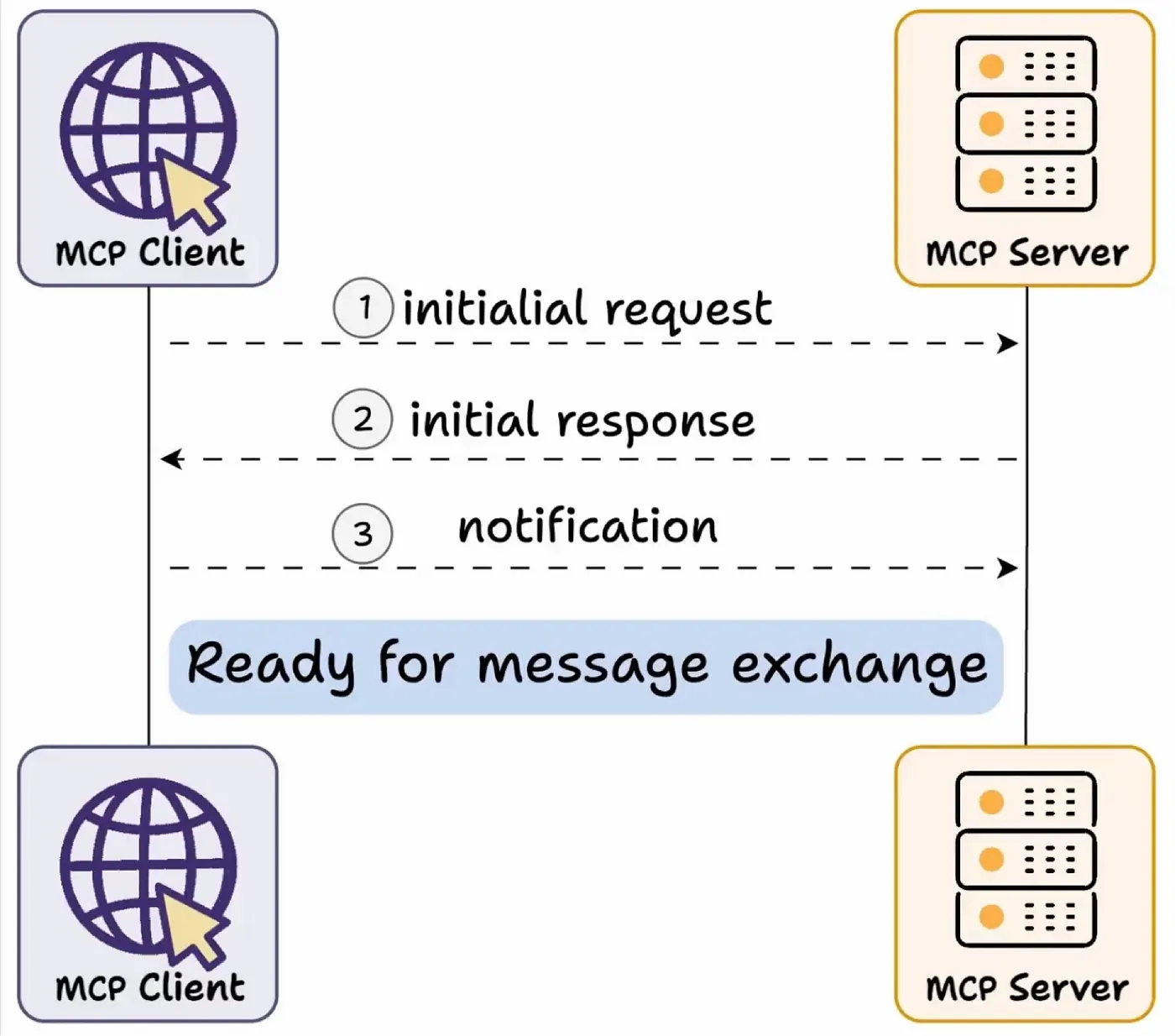

交互流程通常如下:MCP 客户端首先与 MCP 服务器建立连接。然后,客户端可以通过称为“反射”(reflection)的过程发现服务器提供的功能,从而了解哪些工具、资源和提示可用。当 AI 模型需要访问外部信息或执行操作时,客户端会向相应的服务器发送请求,指定所需的工具或资源以及任何必要的参数。服务器处理该请求,与相关的外部系统进行交互,并将结构化的响应发送回客户端。

MCP 的关键特性

双向通信能力: MCP 支持双向通信,这意味着 AI 模型不仅可以接收信息,还可以通过服务器触发外部系统中的操作。

灵活的传输方式: 客户端和服务器之间的通信可以通过各种传输方法进行,包括标准输入/输出(stdio)、WebSockets、HTTP 服务器发送事件(SSE)和 UNIX 套接字,为不同的部署场景提供了灵活性。

标准化的连接过程: 建立 MCP 连接涉及一个握手过程,客户端和服务器在此过程中交换关于其协议版本和功能的信息。

模块化架构设计: MCP 架构中清晰的角色分离使得 AI 集成能够采用模块化和可扩展的方法。AI 应用程序(客户端)可以专注于其核心的推理和交互逻辑,同时依赖于专门的 MCP 服务器来处理与各种外部系统接口的复杂性。这种设计促进了代码的重用,简化了开发过程,并促进了更加互联的 AI 生态系统的发展。

MCP 的安全机制

安全是模型上下文协议设计中一个核心原则。确保安全通信和对数据与工具的受控访问至关重要。宿主应用程序(即运行 AI 模型的应用程序)通过控制哪些 MCP 客户端可以连接到哪些 MCP 服务器以及它们拥有的权限来管理安全性。MCP 包含多种安全机制,包括:

- 身份验证和授权:MCP 强调使用强大的身份验证方法来验证客户端和服务器的身份,并实施授权策略来控制每一方允许执行的操作。这可能涉及多因素身份验证(MFA)和基于角色的访问控制(RBAC)等技术。对于远程连接,通常使用 OAuth 2.0 和 OpenID Connect 进行安全的 API 身份验证。

- 数据加密:客户端和服务器之间交换的敏感数据在传输过程中(例如,使用 TLS)和存储时(例如,使用 AES-256)都会受到加密保护。安全密钥管理在这个过程中也至关重要。

- 数据验证和完整性检查:MCP 的实现通常包括验证传入数据并确保其完整性的机制。这可能涉及使用校验和和加密哈希进行数据验证,以及实施实时异常检测以识别可疑活动。

- 安全的 API 端点和数据交换:鼓励在 MCP 实现中采用保护 API 端点的最佳实践,例如清理输入、验证所有传入数据以及定期更新 API 安全设置。还可以采用速率限制来防止潜在的滥用。

- 最小权限原则:遵循最小权限原则,即仅向客户端和服务器授予执行其特定任务所需的必要权限,这是 MCP 中的一个关键安全考虑因素。

- 监控和审计:对协议事件、消息流和错误进行全面日志记录对于安全监控和合规性至关重要。这使得组织能够跟踪 AI 活动,检测异常交互,并维护所有 MCP 服务器交互和资源访问模式的审计跟踪。

- 用户同意:MCP 通常要求在 AI 模型可以访问敏感数据或调用可能产生副作用的工具之前获得用户的明确同意,从而确保透明度和用户对 AI 操作的控制。细粒度的同意选项允许用户微调不同操作的权限。

对于可以通过互联网访问的远程 MCP 服务器,身份验证和授权变得更加重要。通常使用 OAuth 允许用户授予 MCP 客户端访问其数据或服务的权限,而无需共享密码。

MCP 分层的安全方法,包括身份验证、授权、加密、数据完整性检查和用户同意机制,为实现 AI 模型与外部系统之间的安全双向通信提供了一个强大的框架。这种对安全性的关注对于建立信任和促进 AI 在各种应用程序中的负责任采用至关重要。

MCP 的实际应用案例与场景

- 企业数据助手:想象一下公司内部的 AI 助手,它可以通过标准化的 MCP 连接器安全地访问和检索来自各种内部系统的信息,例如人力资源数据库、项目管理工具和企微等通信平台。

- AI 驱动的编码助手:Cursor、Zed、Replit、Codeium 和 Sourcegraph 等 IDE 正在集成 MCP,以使 AI 代理能够更好地检索与编码任务相关的信息,访问广泛的代码库、文档,甚至执行诸如运行测试或部署代码之类的操作。

- AI 驱动的数据查询:MCP 简化了将 AI 模型连接到 PostgreSQL、SQLite 和 Snowflake 等数据库的过程,使用户能够使用自然语言查询执行数据分析和生成报告。

- 桌面 AI 应用程序:Anthropic 自己的 Claude Desktop 利用 MCP 允许 AI 助手安全地访问用户计算机上的本地文件、应用程序和服务,从而增强其提供上下文相关响应和直接在用户机器上执行任务的能力。

- 自动化数据提取和网络搜索:Apify 等平台开发了 MCP 服务器,允许 AI 代理访问所有 Apify Actors,从而简化了自动化数据提取和网络搜索等任务,而无需用户直接参与。Brave Search 也提供了一个用于网络和本地搜索的 MCP 服务器。

- 实时数据处理:MCP 可用于需要与实时数据流交互的应用程序,例如处理实时传感器数据或与金融市场数据流交互。

- 多工具协调:MCP 通过允许 AI 代理集成和协调多个工具来促进复杂的工作流程,例如访问文件系统以检索信息,然后使用企微等通信工具共享结果。

- 与各种平台的集成:越来越多的 MCP 服务器可用于或正在为流行的企业系统开发,例如 Google Drive、Slack、GitHub、Git、Postgres、Stripe等等。

- AI 图像生成:EverArt 和 Replicate 等服务提供 MCP 服务器,允许 AI 模型根据文本提示生成图像。

- 网络运营:Ciena 等公司利用 MCP 应用程序来提供智能网络控制,帮助网络运营经理防止容量耗尽并快速查明和解决光纤故障。

- 主题公园信息:已经构建了一个 MCP 服务器来公开主题公园 API 的功能,允许用户提出诸如“明天 Epcot 几点开门?”或“迪士尼乐园的太空山排队时间有多长?”之类的问题。

这些多样化的示例说明了 MCP 在各个行业和用例中的广泛适用性。从增强开发者工作流程到自动化复杂的业务流程,甚至实现与日常工具更直观的交互,MCP 为构建智能和互联的 AI 应用程序提供了标准化的基础。

MCP 与其他数据连接/集成方案的比较

| 功能 | MCP | 传统 API | 函数调用 | 其他 AI 集成框架 |

|---|---|---|---|---|

| 集成工作量 | 单一、标准化 | 每个 API 单独集成 | 因 LLM 提供商而异 | 因框架而异 |

| 实时通信 | 是 | 否(通常是请求-响应) | 否 | 是/否(取决于框架) |

| 动态发现 | 是 | 否 | 否 | 是/否(取决于框架) |

| 可扩展性 | 更容易 | 可能很复杂 | 取决于底层实现 | 因框架而异 |

| 安全性和控制 | 跨工具一致,宿主控制 | 因 API 而异 | 依赖于 LLM 提供商和工具实现 | 因框架而异 |

| 目标用户 | AI 代理、开发者 | 通用应用程序、开发者 | LLMs | AI 代理、开发者 |

| 标准化 | 开放标准 | 各种标准(REST、SOAP 等) | 供应商特定 | 因框架而异(有些是专有的) |

| 互操作性 | 高 | 低(需要特定的集成) | 受 LLM 提供商限制 | 因框架而异 |

| 成熟度和生态系统 | 较新,快速增长 | 成熟,生态系统广泛 | 相对较新 | 因框架而异 |

最后

今年被誉为是“AI Agent元年”,OpenAI 的 DeepResearch 和国内创业公司推出的 Manus 等代表性 AI Agent 深受用户喜爱和推崇,这种 AI Agent 不仅拥有强大的基础模型,还集成了联网、浏览器使用、代码运行等多种工具,最终才展现了强大的自主任务规划和处理能力。模型上下文协议(MCP)作为开放标准,为大型语言模型(LLM)与外部数据源和工具之间的交互提供了统一的接口。MCP 的意义不仅仅在于简化技术集成,它代表着向更互联、更高效、更强大的 AI 生态系统的根本转变,在这个生态系统中,不同的模型和工具可以无缝地协同工作。这不仅可能给各个行业释放新的生产力和创新水平,还为构建复杂的 AI Agent 奠定了基础。